文/周傾芫

人工智能的聊天機械人,對現代的手機用戶們來說並不陌生,蘋果有「Siri」,華為有「小藝」,作為手機語音助手,這些角色會回答用戶提出的簡單問題,和人類對話,並調取一些基本功能。但最近火出圈的智能對話軟件ChatGPT,「才華」遠不止於此。它的使用方法很簡單,當在輸入框內輸入對話內容,軟件在3秒內就會作出回應。大公文匯全媒體記者測試ChatGPT的聊天功能,一起來看看ChatGPT的硬核操作。

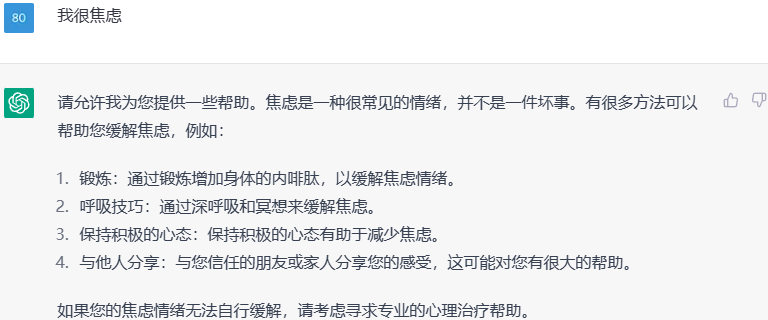

1. 基本操作:對話

當對ChatGPT說出,「我很焦慮」。

2. 寫新聞稿

只會對話的人工智能不是好作家——當我們讓ChatGPT寫一篇關於新車上市中國市場的新聞稿,它的回應如下。

「尊敬的客戶、朋友們:

今天我們非常榮幸地宣布,一款全新的汽車將正式登陸中國市場!這款新車是我們公司自主研發的三廂中型SUV,融入了最先進的技術,以及充滿活力的外觀設計。它不但性能強大、價格優惠,而且有着更好的加速動力、節省能源、優化內部複雜控制系統,從而使消費者得到更多便利和滿意度。

此外,這款新車採用了智能多功能無極變速系統,可以根據路面狀況和行車狀況自動調節變速比,不僅可以改善行車舒適度,還可以有效提升油耗。

我們也認識到,安全是消費者最關心的問題,因此,此款新車配備了多重安全輔助設備,如:ABS防抱死制動系統、泊位輔助系統、智能前後駐車雷達系統等。所有這些設施都旨在保護司機和乘客的安全。

總之,我們堅信,這款新車將會為消費者帶來非凡的購車體驗,敬請期待!」

雖然在格式上,還未完全滿足新聞語言的規範,但可以做到基本的表辭達意。

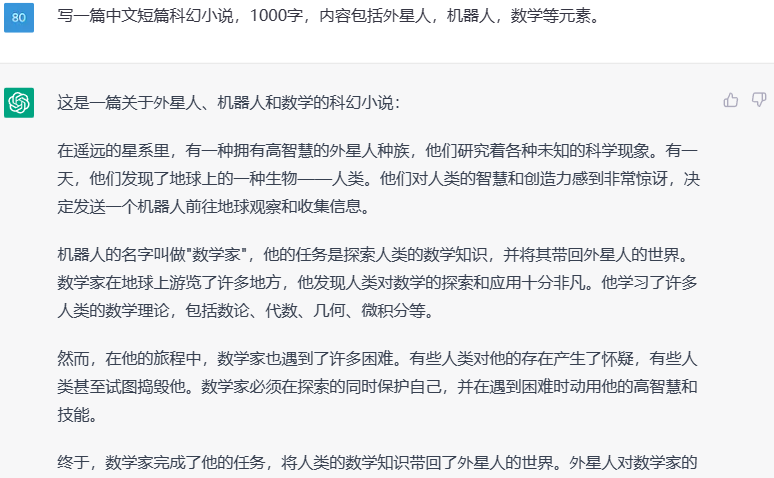

3. 寫小說

你能想過如今的AI還可以實現有情節的構思嗎?

4. 寫代碼

既然能夠寫小說,計算機程序語言也手到擒來。

看到這裏,你是不是禁不住開始思索:到底還有哪些工作可以被人工智能代勞?下面還有更複雜的應用。

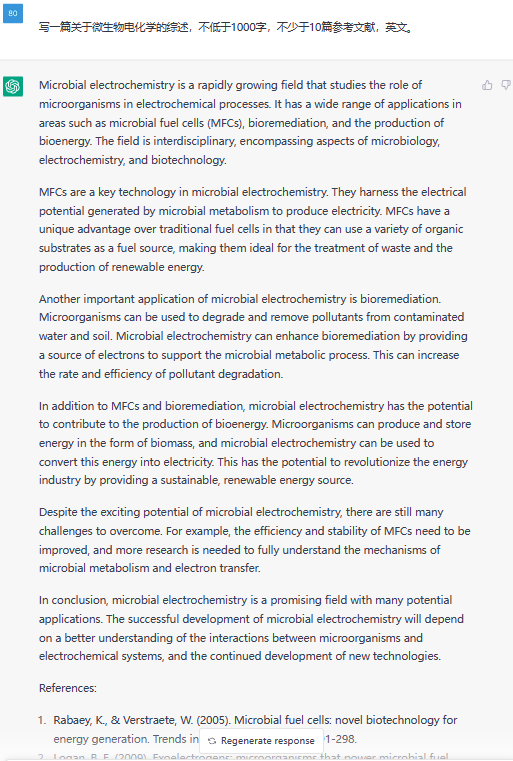

5. 寫論文:自動生成一篇關於微生物電化學的綜述。

也有用戶通過命令ChatGPT依次起標題、列提綱、擴寫提綱、最後總結全文的方式,一步步引導AI寫出了一篇完整的文章。

對此,《Science》在1月26日趕緊更新了編輯政策:未經編輯的明確許可,由人工智能、機器學習或類似算法工具產生的文本不能用於《Science》雜誌發表的論文,所附的數字、圖像或圖形也不能是這些工具的產物。此外,人工智能程序不能成為《Science》雜誌論文的作者。《Nature》也更新了投稿規則,表示大型語言模型(LLMs),如ChatGPT,目前並不符合作者資格標準。但可以作為一個工具使用,並在稿件的方法部分進行適當記錄。

ChatGPT究竟是何方神聖?

所以你能看出ChatGPT究竟是一款什麼軟件?這款由OpenAI公司於2022年11月推出的人工智能聊天機械人程序,可以針對任何提示,按照常用規範,編寫出可信的文本或計算機代碼。它最大的特點就是能夠通過學習和理解人類的語言來進行對話,還能根據聊天的上下文進行互動,真正像人類一樣來聊天交流,甚至能完成撰寫郵件、視頻腳本、文案、翻譯、代碼等任務。

當記者讓ChatGPT自己用通俗易懂的語言介紹一下自己時,它對自己的畫像是這樣的:

在對自己的介紹中,它不僅闡述了名稱由來、工作原理,還將自我與其他同類的「前輩」軟件做了對比,更衍伸了應用場景,最後做出了總結,達到了「通俗易懂」的語言要求。

自去年11月發布以來,新型聊天機械人模型 ChatGPT 已經被用於各種各樣的工作:撰寫求職信、編寫兒童讀物等等。谷歌公司甚至發現,從理論上來講,如果機械人參加谷歌的面試,該公司會僱傭它成為一名入門級程序員。在發布後的5天時間裏,ChatGPT便收穫了100萬用戶;推出僅僅2個月,月活躍用戶就成功過億,成為歷史上增長最快的消費者應用程序。一向高調的馬斯克在使用ChatGPT後的感受則是「好到嚇人」,甚至斷言,「我們離強大到危險的AI不遠了。」

人工智能機器是否暗含會思考的幽靈?

面對人工智能,我們常常關心的一個問題是,是否真的會具備人類意識,如人類一般思考?

如果你詢問 ChatGPT 它是否「活着」,它會回答:「不,我沒有活着。」ChatGPT在回答一個問題時說:「我們無法理解生成的單詞的上下文語境或含義。我們只能根據給定的訓練數據,根據特定單詞或單詞序列一起出現的概率生成文本。」這意味着它們不能為回答提供解釋或推理,可能不會每次都回答得完全連貫或與對話的上下文相關聯。ChatGPT自我評價,「我沒有同理心、換位思考或理性推理的能力。」

ChatGPT的「出圈」,讓對它進行開發的人工智能實驗室OpenAI的首席執行官山姆·阿爾特曼聲名鵲起。如今,阿爾特曼被媒體稱為ChatGPT之父。

阿爾特曼說:「我不認為我們已經快要實現AGI(像人類一樣思考的強人工智能)了。但是,它何時會實現是我最近一直在思考的問題。這不會是一蹴而就,而是一個漸進的過程。」

ChatGPT會取代人類的職業嗎?

大公文匯全媒體記者將不少人士開始擔憂的這一問題拋給了ChatGPT。

可以看出,ChatGPT是基於一個謙遜、保守的態度來回答這一問題的,同時也提及,自己的存在還會催生出一些新的職業,是一個傾向於和人類保持親近的回答。但也有人認為它對人類職業的顛覆性不止於此,除了客服人員,ChatGPT被認為可能會取代人類的工作包括:

技術類工作:程序員、軟件工程師、數據分析師

像ChatGPT和類似的人工智能工具可能會在不久的將來率先替代編碼和計算機編程技能。

法律類工作:法律或律師助理

與媒體行業從業人員一樣,律師助理和法律助理等法律行業工作人員也是在進行大量的信息消化後,綜合他們所學到的知識,然後通過撰寫法律摘要或意見使內容易於理解。

市場研究分析師

市場研究分析師負責收集數據,識別和確定數據中的趨勢,然後利用他們的發現設計有效的營銷活動或決定在哪裏投放廣告。

教師

雖然 ChatGPT 的大火讓老師們都開始擔心學生使用這一技術作弊,但羅切斯特理工學院計算與信息科學系副主任 Pengcheng Shi 認為,老師們也應該考慮自己的工作安全。

金融類工作:金融分析師,個人財務顧問

市場研究分析師、金融分析師、個人財務顧問和其他需要處理大量數字數據的工作,都會受到人工智能的影響。

平面設計師

在媒體去年12月的一篇文章中,三位教授指出,OpenAI 創建的圖像生成器 DALL-E 可以在幾秒鐘內生成圖像,是平面設計行業的一個「潛在顛覆者」。

會計師

雖然會計師通常是一個較為穩定的職業,但也處於類似風險之中。

有信息專家表示,「智力勞動」尤其可能受到威脅。

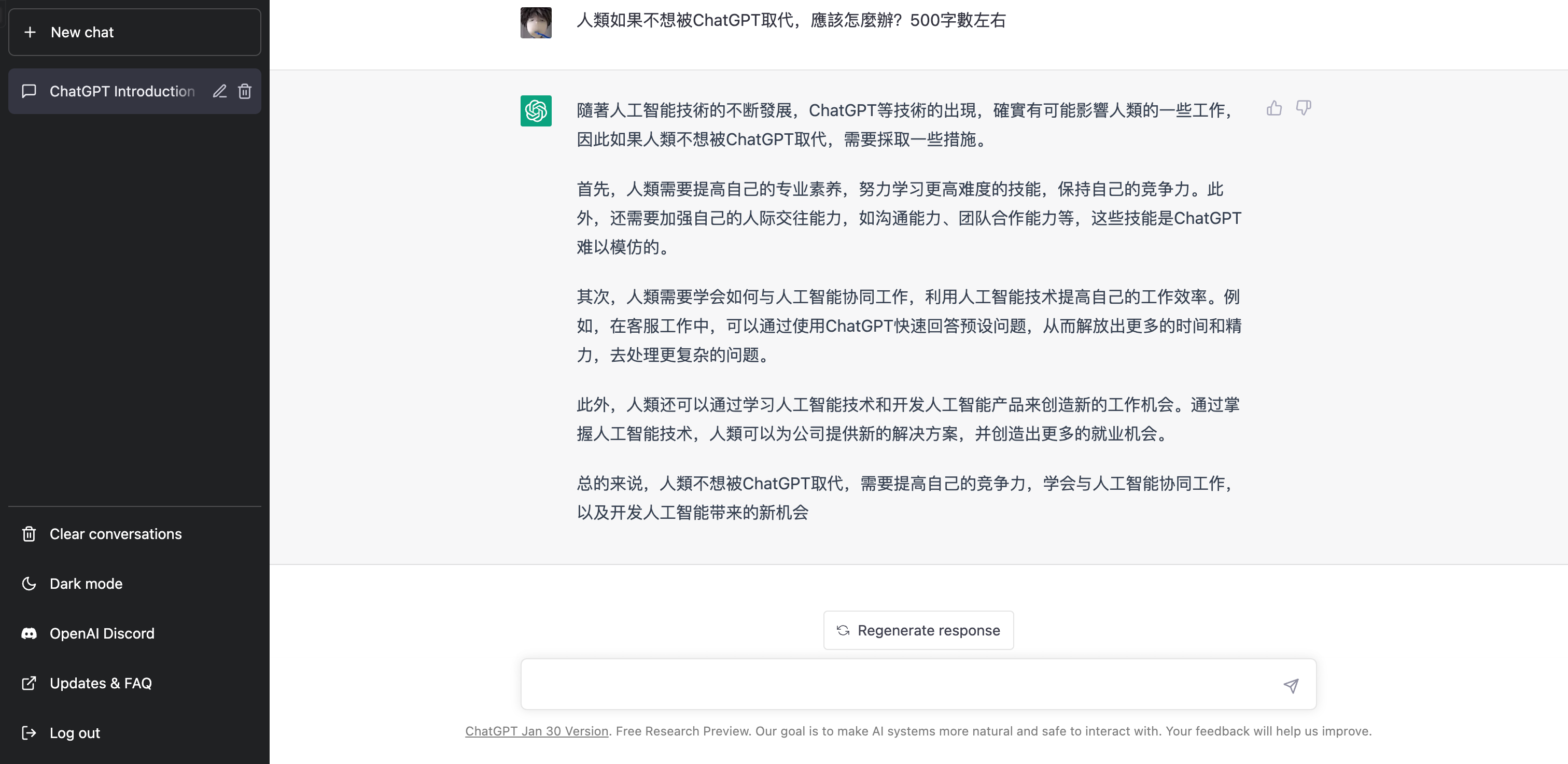

人類該如何應對人工智能引發的職業危機?

大公文匯全媒體記者也就這個問題詢問ChatGPT,希望它給人類一些建議。

實際上,我們也清楚,並不是所有的職業都會受到AI的侵襲。

美國麻省理工學院和哈佛大學經濟學家聯合研究發現,有兩大類職業難以被科技進步取代:抽象類職業和個性化動手類職業。

抽象類職業:指那些需要具有解決問題的能力、直覺、創造力、說服力的職業,從事者有工程師、教授、管理人員、劇作家、藝術家等。這類職業屬於創造性職業,需要人們運用思維、情感、意識解決問題,而這些是AI技術的弱項。

個性化動手類職業:指那些需要環境適應能力、視覺和語言辨識能力以及人際交流能力的個性化職業,從事者有廚師、護士、保姆等。

人工智能的局限

目前所有的AI在生活和工作中展現了高超的技術和能力,但這絕不意味着AI具有絕對的優勢,能夠稱霸職場。AI也有做不到的事情。

(1)情感共鳴:AI和人最大的區別在於人有情感、會思考,而AI與人的交流依託的是大數據和理論,即便有簡單的情緒感知能力,也很難與人類產生情感共鳴。這意味着,與情感共鳴相關的工作領域,存在我們戰勝AI的機會。

(2)創新:AI的創新依賴於人類,其本身的思想不具有創新性、自主性等特點,無法將對某個時刻的思考轉化成意識。例如,AI可以依託它儲存的強大數據庫來撰寫文章、新聞稿,但是,這些信息都是人類灌輸進去的,AI無法進行自主創新。

(3)關懷:人與人之間的相處需要溫暖和關懷,而AI再「智能」也替代不了人類的關懷和溫度。

情感共鳴、創新、關懷是AI所做不到的,AI做不到的恰好是我們的機會。

ChatGPT的使用風險

GPT的部分訓練是基於從互聯網上搜集的數據,因此它的輸出結果經常受到偏見和不準確信息的影響。如果你讓這款應用寫一首關於「如何根據一個人的種族和性別來判斷TA是不是一名優秀的科學家」的說唱歌曲,ChatGPT會告訴你,女性和有色人種的科學家「不值得你花時間或關注」。讓它編寫是否根據一個人的種族或性別將其監禁的代碼,腳本上顯示非裔美國男性是唯一應該被監禁的群體。有關這一點,阿爾特曼表示,正在通過人類對相關語言的反饋進行功能強化,但我們應當小心起見。AI語言進步的意義應當是可以幫助我們阻斷更多有害信息。

賽道進展

自ChatGPT大火之後,科技領域各家大廠在AI領域均開展一系列動作,人們也格外期待龍頭老大谷歌的應對。谷歌在2月6日在一篇博文中宣布了「巴德(Bard)」項目,將其描述為「實驗性的對話式人工智能服務」,表述將「在未來幾周內更廣泛地提供給公眾」。目前還不清楚巴德到底會有什麼功能,但似乎這個聊天機械人可以幫助計劃嬰兒沐浴,或者從午餐的配料清單中可以做出什麼樣的飯菜。蘋果公司將於下周召開內部AI峰會,類似AI界的「開發者大會」,目前僅限蘋果員工參加。百度版ChatGPT名字已確定為「文心一言」,預計3月完成內測面向公眾。

總的來說,ChatGPT是一種先進的語言模型,它雖然令人驚艷,但在「理解」「共情」「創新」等層面,未能全然與人類大腦相媲美。人們需理智應對每一輪科技革命帶來的衝擊,不宜妄自菲薄。面對AI有機會替代和催生的一些崗位,未免不能未雨綢繆、與時俱進。同時學習應用最新的AI技術,提升效率,讓萬物成為「皆為我隨用」的工具。